5.4 結果

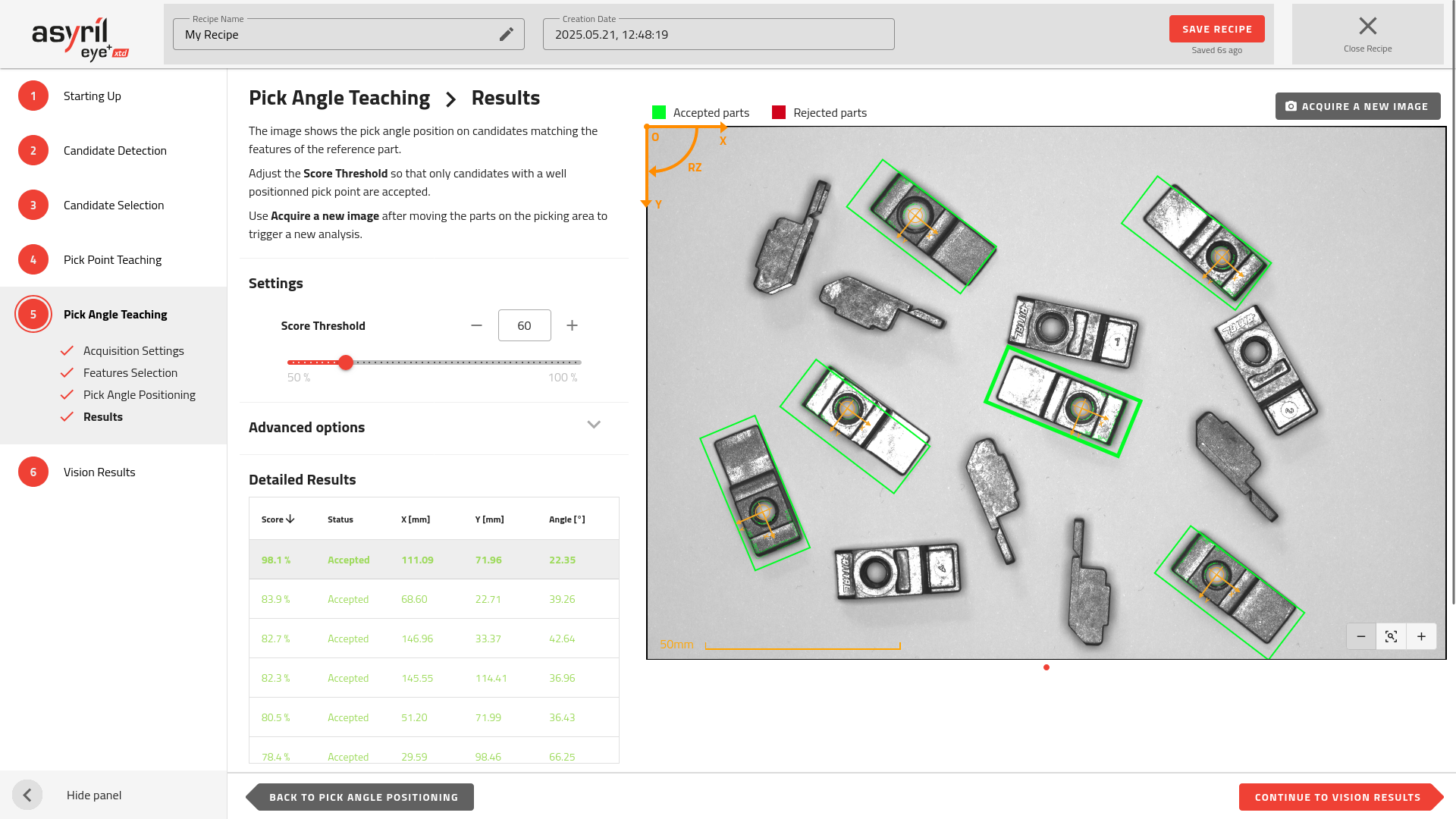

図 110 ピック角度の学習 - 結果

このステップでは、選択した特徴で定義された 参照モデル が、他の適当な候補とどれだけ一致しているかを評価します。

参照モデルは回転・整列され、各部品で検出された特徴と最適に一致する位置を探します。これにより、部品の向きの違いがあっても一貫して正確なピック角度の位置決めが可能になります。

システムは定義されたピック角度を使って、Rz 座標をロボットに返します。

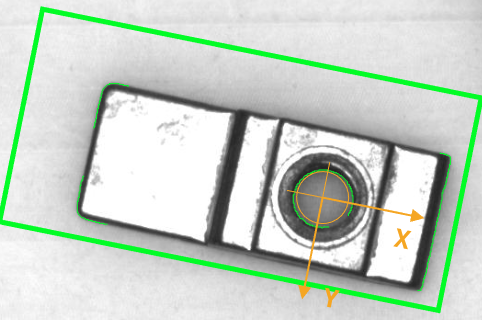

図 111 ピッキング角度の学習の結果 - ある部品の拡大

ヒント

ピッキングエリア上の部品を手動で動かし、新しい画像を取得する を押して、異なる位置でもピック角度が正確に検出されるかテストできます。

各候補には スコア が付与され、その特徴と参照モデルとの一致度(%)を表します。スコアが 100% なら完全に一致しています。

ヒント

結果テーブルでスコア順に部品を並べ替え、高スコアの部品のみが受け入れられているか素早く確認しましょう。しきい値を調整して、正確に検出された部品(緑の長方形で強調表示)だけを残すようにしてください。

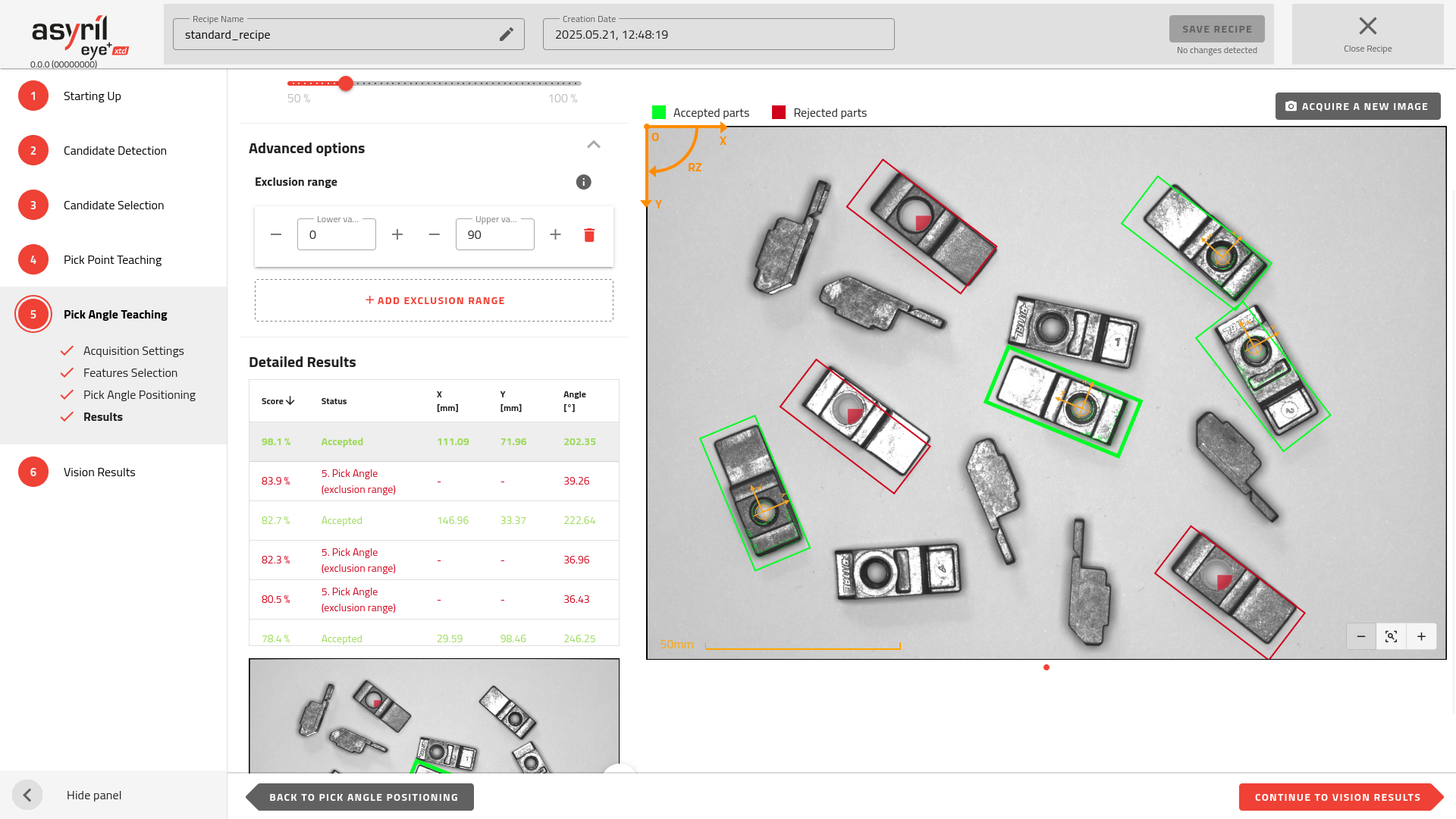

高度なオプション

高度なオプションの設定では、最大4つの角度除外範囲を定義できます。

注釈

各除外範囲は2つの角度で定義され、その範囲内に部品の向きが入ると 拒否 されます。

除外範囲は -360°〜360° の値で設定できますが、ビジョンシステム内部では [0°、360°] の範囲で処理されます。そのため、負の角度は保存時に自動的 に36 0°を加算して対応する正の角度に変換されます。

例えば、除外範囲 "[-30°; 30°]" は "[330°; 30°]" として保存されます。

図 112 ピック角度の学習の結果は、除外範囲が [0°; 90°] に設定されている

重要

レシピウィザードでは、角度は画像の左上の座標系で定義された視覚参照フレームで表現されます。しかし自動運転中は、EYE+ は ハンドアイキャリブレーション によって計算されたロボットフレームの角度を返します。